Recentemente, escrevi sobre a decisão da 9ª Câmara Criminal Especializada do Tribunal de Justiça de Minas Gerais que absurdamente reconheceu atipicidade material em um caso envolvendo uma menina de 12 anos e um homem de 35.

A idade era incontroversa. Doze anos.

Ainda assim, por maioria, entendeu-se que a aplicação da pena seria inadequada diante do suposto contexto familiar narrado. O homem com passagens por tráfico de drogas, homicídio e outros crimes namorando uma criança de doze anos de idade? Sim. Foi isso. Namorando com intuito de constituir família… absurdo. Sim. Absurdo.

A mãe dela também foi inocentada pelo acórdão. Apesar de receber cestas básicas do homem que mantinha relações com a filha dela. No meu entendimento, essa mulher estava vendendo a própria filha em troca de comida.

E o Estado falhando na base… falhou quando não proporcionou à essa família a vara para que pudessem buscar o peixe. Mas isso é tema para outro momento.

O pai da criança não foi denunciado. E aí me pergunto porque? Afinal, a responsabilidade de criar e cuidar é de pai e mãe. Então, porque somente a mãe estava sendo acusada?

Para absolver os acusados, a 9ª Câmara se baseou em julgados anteriores em que homens de 18 ou 19 anos eram julgados por manter relações sexuais com crianças de 13 anos. E, naqueles casos, a tese distinguishing(distinção e não obrigação de se seguir o que já está decidido pelos tribunais superiores em casos parecidos) foi usada para absolver os adultos porque a diferença etária entre homem que abusou e vítima que consentiu era menor que seis anos.

Agora pensa: no caso de Indianápolis, o homem tinha 35 anos e a menina, 12. Ele tinha quase o triplo da idade dela, sendo totalmente contra a qualquer tese, a sua absolvição.

O debate já era juridicamente delicado e aí surge um fato ainda mais estarrecedor.

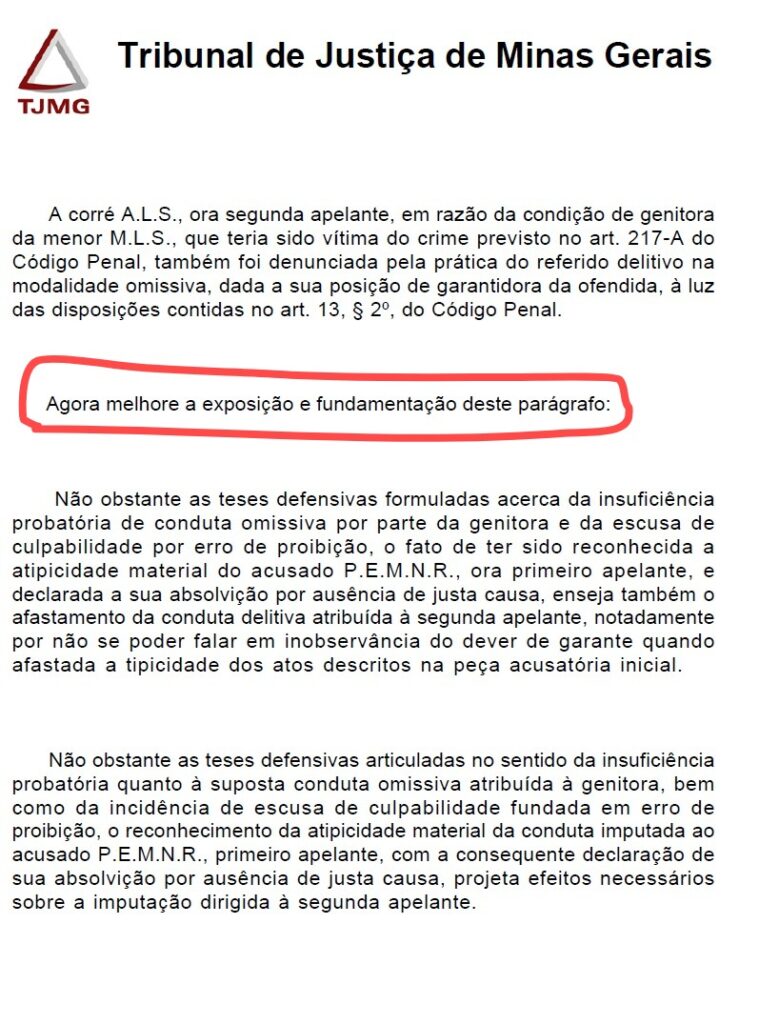

Vejam a página 45:

Na página 45 do acórdão publicado, consta um comando típico de direcionamento a sistema de inteligência artificial para elaboração de fundamentação jurídica. Não se trata de mera redação padronizada. Trata-se de estrutura textual característica de prompt de modo que o tipo de instrução que se fornece a uma ferramenta de IA para que ela gere um voto.

O problema não é, em si, utilizar inteligência artificial como instrumento auxiliar. A tecnologia é realidade no Judiciário, e pode ser aliada da eficiência. O problema é outro: o comando permaneceu no texto final assinado e publicado.Isso significa que o documento não passou por curadoria adequada.

E aqui mora o verdadeiro risco institucional. Decisões judiciais exigem fundamentação pessoal e motivação explícita, nos termos do artigo 93, IX, da Constituição Federal. A assinatura de um acórdão não é ato protocolar. É ato de responsabilidade. Quem assina assume a autoria intelectual da decisão.

Quando um comando bruto de geração automatizada permanece no corpo do voto, a mensagem que se transmite é perturbadora: ou não houve leitura final, ou houve delegação substancial da redação decisória sem controle efetivo.

Como advogada, confesso que a sensação é ambígua.Nós já sabemos que muitos julgadores não leem integralmente o que os advogados escrevem. Isso faz parte da realidade forense, ainda que não devesse. Mas agora surge algo ainda mais inquietante: a impressão de que, em alguns casos, não se lê sequer o que o próprio gabinete produz.

Institucionalmente, isso é grave.

O Poder Judiciário não se sustenta apenas na autoridade formal. Sustenta-se na confiança pública. A legitimidade da jurisdição decorre da convicção de que houve reflexão humana, análise concreta, responsabilidade individual pelo que foi decidido.

Inteligência artificial não deveria decidir. Quem deveria decidir é o magistrado.

Mas, se o texto publicado revela que a ferramenta falou antes da revisão humana (e assim permaneceu), a percepção de autoria se fragiliza. E quando a autoria se fragiliza, a responsabilidade também.

No Direito de Família, lidamos diariamente com a vida real das pessoas: guarda de filhos, alimentos, patrimônio construído em décadas. O que mais pedimos ao Judiciário é cuidado. Atenção. Leitura atenta.

Curadoria.

A inteligência artificial pode redigir, pode sugerir pode organizar.Mas não pode substituir consciência, prudência e responsabilidade.

Assinar é assumir.

E, quando ninguém lê o que assina, o problema deixa de ser tecnológico. Passa a ser institucional.

Porque decisões judiciais não podem parecer automáticas.

Elas precisam ser humanas, inclusive nos erros.